AWS ابزارهای جدیدی را در Amazon Bedrock و Amazon SageMaker AI معرفی کرده است تا به شرکت ها در ساخت هوش مصنوعی اختصاصی و مدل های زبان بزرگ سفارشی کمک کند و مزیت رقابتی ایجاد کند.

درست پس از اعلام نوا فورج، سرویسی برای آموزش مدل های سفارشی هوش مصنوعی نوا، سرویس های وب آمازون (AWS) ابزارهای بیشتری را برای مشتریان سازمانی معرفی کرد تا به آن ها در ساخت هوش مصنوعی اختصاصی و مدل های پیشگام خودشان کمک کند.

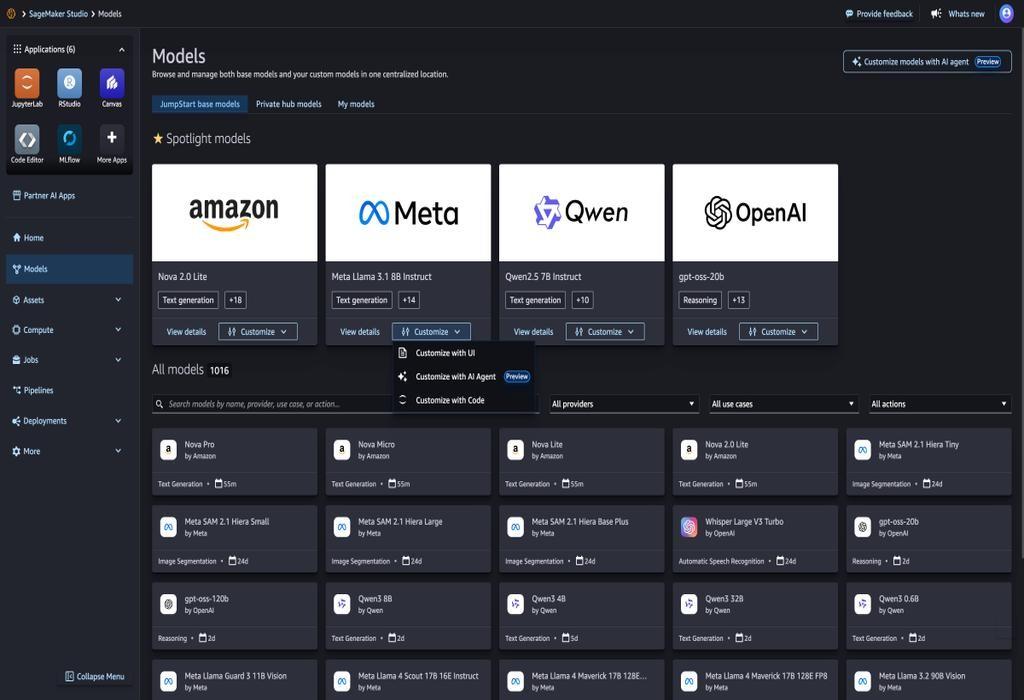

AWS در کنفرانس AWS re:Invent خود در روز چهارشنبه، قابلیت های نوین مدیریت عامل هوش مصنوعی را در آمازون بِدراک و آمازون سِیج مِیکر AI معرفی کرد. این قابلیت های جدید برای آسان تر کردن ساخت و بهینه سازی مدل های زبان بزرگ سفارشی (LLMها) برای توسعه دهندگان طراحی شده اند و امکان ساخت هوش مصنوعی اختصاصی را فراهم می آورند.

قابلیت های جدید AWS برای ساخت هوش مصنوعی اختصاصی

به گفته آنکور مهروترا، مدیر کل پلتفرم های هوش مصنوعی در AWS، در مصاحبه ای با تک کرانچ، ارائه دهنده خدمات ابری در حال معرفی قابلیت سفارشی سازی مدل بدون سرور در سِیج مِیکر است که به توسعه دهندگان این امکان را می دهد تا بدون نیاز به فکر کردن درباره منابع محاسباتی یا زیرساخت، شروع به ساخت هوش مصنوعی اختصاصی و یک مدل کنند.

برای دسترسی به این قابلیت های ساخت مدل بدون سرور، توسعه دهندگان می توانند یا یک مسیر اشاره و کلیک خودراهنما را دنبال کنند و یا یک تجربه با هدایت عامل که در آن می توانند سِیج مِیکر را با استفاده از زبان طبیعی هدایت کنند. این قابلیت به آن ها در مسیر ساخت هوش مصنوعی اختصاصی کمک شایانی می کند و در حال راه اندازی در حالت پیش نمایش است.

مهروترا گفت: “اگر شما یک مشتری در حوزه مراقبت های بهداشتی باشید و بخواهید مدلی داشته باشید که اصطلاحات پزشکی خاصی را بهتر درک کند، می توانید به سادگی سِیج مِیکر AI را هدایت کنید، البته اگر داده های برچسب گذاری شده داشته باشید، سپس تکنیک را انتخاب کنید و سِیج مِیکر شروع به کار می کند و مدل را بهینه سازی می کند تا در نهایت به ساخت هوش مصنوعی اختصاصی شما منجر شود.”

این قابلیت برای سفارشی سازی مدل های نوای خود آمازون و برخی مدل های متن باز (آنهایی که وزن مدل هایشان به صورت عمومی در دسترس است)، از جمله دیپ سیک و لاما از متا، در دسترس است.

چگونگی ساخت هوش مصنوعی اختصاصی با بهینه سازی تقویتی

AWS همچنین در حال راه اندازی قابلیت “بهینه سازی تقویتی” (Reinforcement Fine-Tuning) در بِدراک است که به توسعه دهندگان این امکان را می دهد که یا یک تابع پاداش یا یک جریان کاری از پیش تعیین شده را انتخاب کنند، و بِدراک فرآیند سفارشی سازی مدل را به صورت خودکار از ابتدا تا انتها اجرا خواهد کرد، که گامی مهم در ساخت هوش مصنوعی اختصاصی است.

LLMهای پیشگام – یعنی پیشرفته ترین مدل های هوش مصنوعی – و سفارشی سازی مدل به نظر می رسد که در کنفرانس امسال، نقطه تمرکز AWS باشند.

AWS در طول سخنرانی اصلی مت گارمن، مدیر عامل AWS، در روز سه شنبه، نوا فورج را معرفی کرد؛ سرویسی که در آن AWS مدل های سفارشی نوا را با هزینه 100,000 دلار در سال برای مشتریان سازمانی خود خواهد ساخت.

مهروترا گفت: “بسیاری از مشتریان ما می پرسند ‘اگر رقیب من به همین مدل دسترسی داشته باشد، چگونه می توانم خودم را متمایز کنم؟’ ‘چگونه راه حل های منحصر به فردی بسازم که بهینه شده باشند، که برند من را برای داده های من، برای مورد استفاده من بهینه کنند، و چگونه می توانم خودم را متمایز کنم؟’ آنچه ما دریافتیم این است که کلید حل این مشکل، توانایی ساخت هوش مصنوعی اختصاصی و مدل های سفارشی است.”

AWS هنوز پایگاه کاربری قابل توجهی برای مدل های هوش مصنوعی خود به دست نیاورده است. یک نظرسنجی در ماه ژوئیه از Menlo Ventures نشان داد که شرکت ها به شدت Anthropic، OpenAI و Gemini را به سایر مدل ها ترجیح می دهند. با این حال، توانایی سفارشی سازی و بهینه سازی این LLMها می تواند شروعی برای دادن مزیت رقابتی به AWS باشد.

در مجموع، سرویس های وب آمازون با معرفی قابلیت های پیشرفته در بِدراک و سِیج مِیکر AI، به دنبال توانمندسازی مشتریان سازمانی برای توسعه مدل های هوش مصنوعی سفارشی و اختصاصی خود هستند. این ابتکارات با هدف ارائه راه حل های متمایز و بهینه سازی شده برای نیازهای خاص هر کسب وکار، گامی مهم در رقابت پذیری در حوزه هوش مصنوعی محسوب می شود.

AWS doubles down on custom LLMs with features meant to simplify model creation