قرارداد اوپن ای آی با پنتاگون جنجال های زیادی را درباره مرزهای اخلاقی استفاده نظامی از هوش مصنوعی و تفاوت سیاست های امنیتی شرکت های بزرگ این حوزه برانگیخته است.

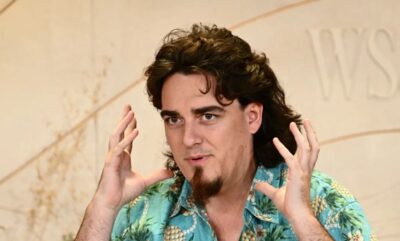

به گفته خودِ سم آلتمن، مدیرعامل OpenAI، توافق این شرکت با وزارت دفاع «قطعا عجولانه» بوده و «ظاهر خوشایندی ندارد.» بحث قرارداد اوپن ای آی با پنتاگون از همین جا آغاز شد.

پس از اینکه مذاکرات بین آنتروپیک (Anthropic) و پنتاگون در روز جمعه به بن بست خورد، دونالد ترامپ، رئیس جمهور، به آژانس های فدرال دستور داد تا پس از یک دوره گذار شش ماهه، استفاده از فناوری آنتروپیک را متوقف کنند؛ همچنین پیت هگست، وزیر دفاع، گفت که این شرکت هوش مصنوعی را به عنوان یک ریسک برای زنجیره تامین در نظر می گیرد.

بعد از آن، OpenAI سریعا اعلام کرد که برای استقرار مدل هایش در محیط های طبقه بندی شده، به توافق مخصوص به خودش رسیده است. با توجه به اینکه آنتروپیک گفته بود برای استفاده از فناوری اش در سلاح های کاملا خودکار یا نظارت داخلی گسترده خط قرمز دارد و آلتمن هم مدعی بود OpenAI همین خط قرمزها را رعایت می کند، سؤالات واضحی پیش آمد: آیا OpenAI درباره پروتکل های امنیتی اش صادق بود؟ چرا آن ها توانستند به توافق برسند اما آنتروپیک نتوانست؟ این سوالات پیرامون قرارداد اوپن ای آی با پنتاگون مطرح شد.

بررسی ابعاد قرارداد اوپن ای آی با پنتاگون

در حالی که مدیران OpenAI در شبکه های اجتماعی از این توافق دفاع می کردند، شرکت هم یک پست وبلاگی منتشر کرد که در آن رویکردش را توضیح می داد. این پست به شفاف سازی ابهامات قرارداد اوپن ای آی با پنتاگون می پرداخت.

در واقع، این پست به سه حوزه ای اشاره کرد که در آن ها مدل های OpenAI اجازه استفاده ندارند: نظارت داخلی گسترده، سیستم های تسلیحاتی خودکار، و «تصمیم گیری های خودکار حساس (مثلا سیستم هایی مثل اعتبار اجتماعی)».

توضیحات OpenAI در مورد قرارداد اوپن ای آی با پنتاگون

شرکت اعلام کرد برخلاف سایر شرکت های هوش مصنوعی که «موانع امنیتی خود را کاهش داده یا حذف کرده اند و در استقرارهای امنیت ملی عمدتا به سیاست های استفاده تکیه کرده اند»، توافق OpenAI از خط قرمزهایش «از طریق یک رویکرد گسترده تر و چندلایه» محافظت می کند. این رویکرد، ویژگی مهمی در قرارداد اوپن ای آی با پنتاگون است.

در این وبلاگ آمده است: «ما اختیار کامل پشته امنیتی خود را حفظ می کنیم، مدل ها را از طریق فضای ابری مستقر می کنیم، پرسنل تایید صلاحیت شده ی OpenAI در جریان کار هستند و محافظت های قراردادی محکمی داریم. تمام این ها علاوه بر محافظت های قوی موجود در قوانین ایالات متحده است.»

شرکت اضافه کرد: «ما نمی دانیم چرا آنتروپیک نتوانست به این توافق برسد و امیدواریم آن ها و آزمایشگاه های بیشتری این موضوع را مد نظر قرار دهند.»

پس از انتشار این پست، مایک ماسنیک از Techdirt ادعا کرد که این توافق «قطعا اجازه نظارت داخلی را می دهد»، زیرا در آن ذکر شده که جمع آوری داده های خصوصی با فرمان اجرایی 12333 (در کنار تعدادی قوانین دیگر) مطابق خواهد داشت. ماسنیک این فرمان را این گونه توصیف کرد: «روشی که NSA نظارت داخلی اش را با ضبط ارتباطات از طریق شنود خطوط خارج از ایالات متحده پنهان می کند، حتی اگر حاوی اطلاعاتی از شهروندان آمریکایی یا درباره آن ها باشد.» این نکات، جنجال پیرامون قرارداد اوپن ای آی با پنتاگون را افزایش داد.

کاترینا مولیگان، مدیر مشارکت های امنیت ملی OpenAI، در پستی در لینکدین استدلال کرد که بخش زیادی از بحث ها پیرامون متن قرارداد با این فرض است که «تنها چیزی که بین آمریکایی ها و استفاده از هوش مصنوعی برای نظارت داخلی گسترده و سلاح های خودکار قرار دارد، یک بند ساده در سیاست استفاده در یک قرارداد واحد با وزارت جنگ است.»

مولیگان گفت: «اصلا این طور نیست» و افزود: «معماری استقرار بیشتر از متن قرارداد اهمیت دارد […] ما با محدود کردن استقرار خود به API ابری، می توانیم تضمین کنیم که مدل هایمان نمی توانند مستقیما در سیستم های تسلیحاتی، حسگرها یا سایر سخت افزارهای عملیاتی ادغام شوند.»

آلتمن همچنین در X به سؤالاتی درباره این توافق پاسخ داد و اعتراف کرد که این کار عجولانه بوده و باعث واکنش های منفی شدیدی علیه OpenAI شده است (تا جایی که چت بات کلودِ آنتروپیک روز شنبه در اپ استور اپل از ChatGPT پیشی گرفت). خب، پس چرا این کار را کردند؟ این توضیحات، نوری بر دلایل قرارداد اوپن ای آی با پنتاگون می تاباند.

آلتمن گفت: «ما واقعا می خواستیم اوضاع را آرام کنیم و فکر می کردیم توافق پیشنهادی خوب است. اگر حق با ما باشد و این کار واقعا منجر به کاهش تنش بین وزارت جنگ و صنعت شود، ما مثل نابغه ها و شرکتی به نظر می رسیم که برای کمک به صنعت، سختی های زیادی را به جان خریده است. در غیر این صورت، همچنان به عنوان یک شرکت […] عجول و بی دقت شناخته خواهیم شد.»

این تحولات نشان دهنده پیچیدگی های تعامل میان استارتاپ های پیشرو و نهادهای دفاعی است. در حالی که OpenAI تلاش می کند با شفافیت و تعیین خط قرمزهای فنی از انتقادات فاصله بگیرد، نگرانی ها درباره نظارت و امنیت همچنان پابرجاست و این شرکت باید در عمل ثابت کند که فناوری اش ابزاری برای نقض حریم خصوصی یا ایجاد خطرات جبران ناپذیر نخواهد بود.

OpenAI shares more details about its agreement with the Pentagon