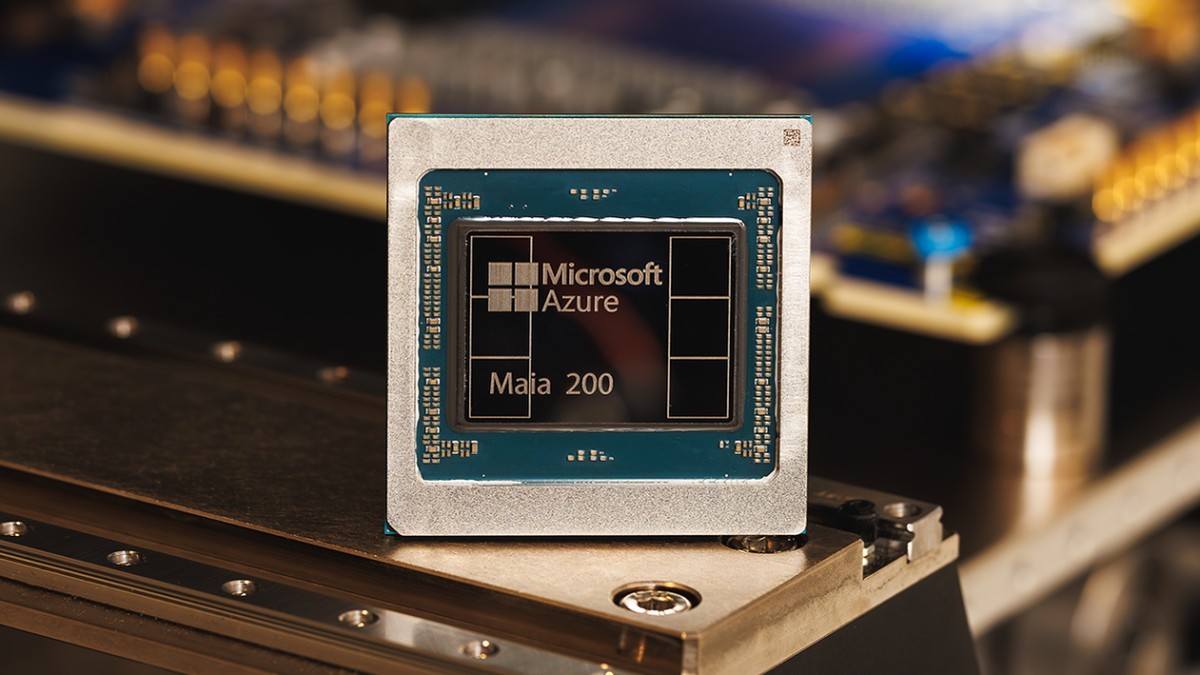

معرفی چیپ هوش مصنوعی مایکروسافت؛ Maia 200

مایکروسافت از عرضه جدیدترین تراشه خودش یعنی Maia 200، که در واقع یک چیپ هوش مصنوعی مایکروسافت است، خبر داده؛ تراشه ای که این شرکت آن را یک اسب کاری سیلیکونی توصیف کرده که برای گسترش استنتاج هوش مصنوعی طراحی شده.

این چیپ هوش مصنوعی مایکروسافت که بعد از نسخه Maia 100 (عرضه شده در سال 1402) آمده، از نظر فنی طوری تجهیز شده که مدل های قدرتمند هوش مصنوعی را با سرعت بیشتر و بازدهی بالاتر اجرا کند. مایکروسافت گفته که Maia با بیش از 100 میلیارد ترانزیستور ساخته شده و می تواند بیش از 10 پتافلاپس در دقت 4 بیتی و حدود 5 پتافلاپس در عملکرد 8 بیتی ارائه دهد که نسبت به مدل قبلی پیشرفت خیلی زیادی داشته.

استنتاج (Inference) به فرآیند محاسباتیِ اجرای یک مدل گفته می شود، در حالی که آموزش (Train) به محاسبات لازم برای یادگیری مدل اشاره دارد. همزمان با بالغ شدن شرکت های هوش مصنوعی، هزینه های استنتاج به بخش خیلی مهمی از کل هزینه های عملیاتی شان تبدیل شده و همین باعث شده تمایل به پیدا کردن راه هایی برای بهینه سازی این فرآیند بیشتر شود.

مایکروسافت امیدوار است که چیپ هوش مصنوعی مایکروسافت Maia 200 بتواند بخشی از این بهینه سازی باشد و کاری کند که کسب وکارهای هوش مصنوعی با اختلال کمتر و مصرف برق پایین تر کار کنند. این شرکت گفته: «در عمل، یک نود Maia 200 می تواند بزرگ ترین مدل های امروزی را بدون هیچ زحمتی اجرا کند و حتی برای مدل های بزرگ تر در آینده هم فضای کافی دارد.»

چیپ هوش مصنوعی مایکروسافت بخشی از یک روند رو به رشد است که در آن غول های فناوری سراغ طراحی تراشه های اختصاصی خودشان می روند تا وابستگی شان به انویدیا (Nvidia) را کمتر کنند؛ شرکتی که پردازنده های گرافیکی پیشرفته اش نقش حیاتی در موفقیت شرکت های هوش مصنوعی دارند. مثلا گوگل واحد پردازش تنسور (TPU) خودش را دارد که به عنوان تراشه فروخته نمی شود، بلکه به عنوان قدرت محاسباتی از طریق سرویس ابری در دسترس است. بعدش نوبت به Amazon Trainium می رسد، تراشه اختصاصی که با هدف ارتقای تحول هوش مصنوعی داخلی سازمان آمازون ساخته شده و جدیدترین نسخش یعنی Trainium3 را همین آذرماه معرفی کرد. در هر کدام از این موارد، می توان از این واحدها برای سبک کردن بار محاسباتی که قبلا روی دوش پردازنده های انویدیا بود استفاده کرد و در نتیجه هزینه کلی سخت افزار را پایین آورد.

مایکروسافت با Maia خودش را آماده رقابت با این جایگزین ها می کند. در بیانیه خبری روز دوشنبه، این شرکت اشاره کرد که این چیپ هوش مصنوعی مایکروسافت عملکرد FP4 را 3 برابر بیشتر از نسل سوم تراشه های Amazon Trainium و عملکرد FP8 را بالاتر از نسل هفتم TPU گوگل ارائه می دهد.

نقش چیپ هوش مصنوعی مایکروسافت در آینده AI

مایکروسافت می گوید که چیپ هوش مصنوعی مایکروسافت Maia همین الان هم به سختی مشغول کار برای تغذیه مدل های هوش مصنوعی تیم «ابر هوش» (Superintelligence) این شرکت است. همچنین این تراشه از عملیات های چت باتِ Copilot هم پشتیبانی می کند. از روز دوشنبه، این شرکت اعلام کرد که از گروه های مختلفی مثل توسعه دهنده ها، دانشگاهی ها و آزمایشگاه های پیشرو هوش مصنوعی دعوت کرده تا از کیت توسعه نرم افزاری Maia 200 در کارهای خودشان استفاده کنند.

توسعه سخت افزارهای اختصاصی مانند Maia 200 نشان دهنده تغییر استراتژی غول های فناوری برای کنترل بیشتر بر هزینه ها و عملکرد مدل های هوش مصنوعی است. این رویکرد نه تنها کارایی سرویس هایی مثل Copilot را افزایش می دهد، بلکه اکوسیستم جدیدی برای توسعه دهندگان فراهم می کند تا با محدودیت های کمتری به نوآوری بپردازند.